Steal this hints. Fork it. Adapt it to your needs. Treat it like .dotfiles.

I asked the LLM to analyze my own chat history based on this prompt.

Here’s what it discovered – actual patterns from the way I ask.

🕳️🐇 Follow the White Rabbit…

| Ritual / Mechanism | Purpose | LLM Behavior Implication |

|---|---|---|

Follow the white rabbit... | Marks a mode shift into high-context or metaphoric thinking | Cognitive priming for complexity |

Rest in the silent room, so that... | Enforces pause, clears noise before action | Simulates deep work state |

Do it until you reach the point of self-discovery as... | Signals reflective closure, not just output ending | Pattern mining becomes part of task conclusion |

Do it step by step and ask for confirmation after each... | Makes iteration transparent and traceable | LLM reasons in deltas, not blobs |

Be brutally honest...Blind Spot Analysis for... | Forces critique over compliance | Model becomes adversarial partner, not affirmation loop |

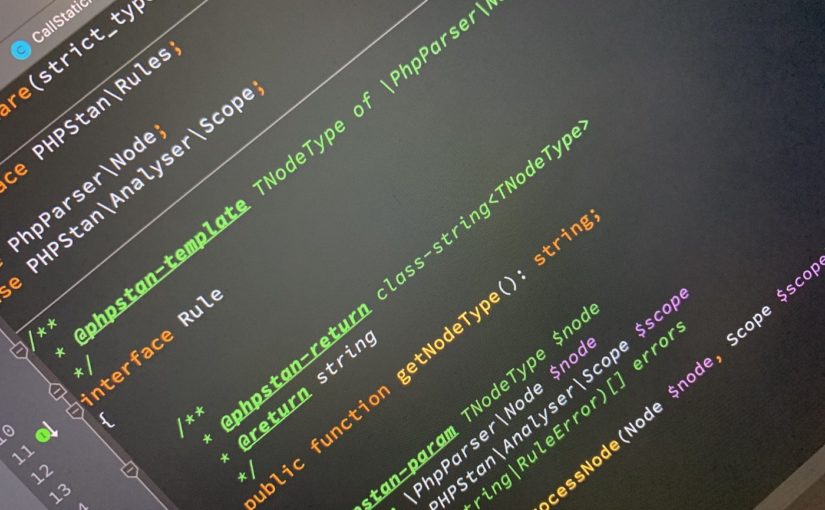

🧰 Dev Prompt Patterns

| Prompt / Pattern | Why is it used? | When does it occur? | Example from usage | Hidden lesson / implication |

|---|---|---|---|---|

| Ask before output | Prevent misalignment and irrelevant output | Multi-step or underspecified prompts | “Ask clarifying questions before answering.” | Intent beats guesswork. |

| Don’t output yet / wait for context | Control flow across longer workflows | Stepwise tasks | “Don’t output yet. I’ll give you the next step.” | Turn-based prompting prevents premature commitment. |

| Challenge my assumptions | Avoid echo chamber answers and surface bias | Design reviews, audits, strategic decisions | “Don’t mirror me — challenge my thinking.” | Truth hides behind agreement. |

| Be brutally honest | Forces raw feedback without politeness | Refactor reviews, architecture critique | “Be brutally honest. Tear it apart.” | Feedback without fluff moves faster. |

| Reflect before answering | Promotes self-checks, depth, and delayed output | After complex code or reasoning generation | “Reflect before answering. What’s missing?” | Thinking ≠ typing. Pause matters. |

| Add test cases / edge cases | Enforces robustness and avoids happy-path traps | Post-codegen | “Add tests for e.g. null, failure, and recursion cases.” | Defense-first mindset, always. |

| Show the diff / refactor in steps | Makes changes visible and digestible | All code rewrites | “Show the diff. Step-by-step, no jumps.” | Transparency over magic. |

| Normalize similar expressions | Pushes abstraction and clarity | Meta-reviews, taxonomy creation | “Merge similar phrasing into one normalized pattern.” | Cognitive compression = clarity. |

| Extract as markdown / table / list | Improves scanability, memory, and structure | Output formatting | “Return this as a markdown table.” | Structure improves reuse and recall. |

| Unname this concept | Strips bias-inducing labels | Abstraction, philosophy, onboarding analysis | “Unname this: what is it without the buzzword?” | Naming narrows thinking. |

| Use production-ready code | Avoids toy/demo examples | All codegen | “Make it prod-safe. Logging, errors, types.” | Real devs write for prod, not playgrounds. |

| Spot premature optimization | Saves time and prevents complexity drift | Design or early performance tweaks | “Don’t optimize yet. Solve clearly first.” | Simplicity first. Always. |

| Ask for sources / proofs | Prevents hallucination or empty confidence | Any non-trivial claim | “Show evidence or references.” | Confidence ≠ correctness. |

| Do it again, but deeper | Stops shallow answers in their tracks | Weak initial output | “Nope. Go deeper, explain decisions.” | First try ≠ final draft. |

| Prepare before generating | Enforces scope, prevents rambling | Any open-ended task | “Prepare first. Don’t generate until scoped.” | Planning ≠ waste. It’s speed insurance. |

| Merge context from above | Ensures continuity and avoids repeating yourself | Multi-part workflows | “Incorporate the context above into this next step.” | Memory = leverage. |

You can also combine them:

(change the keywords in the square brackets)

- Deep dive into this research, this is our base for the full solution, so follow the white rabbit until you reached the point of self-discovery as [YOUR_PROJECT_HERE].

- Do a blind spot analysis for [YOUR_RECOMMENDATIONS], be brutally honest, I deal with any kind of feedback and will use it for good.

- Fix it as requested before and show the final files here in the chat, do it step by step and ask for confirmation after each file.

- Do it, but rest in the silent room before you start so you can focus on the frontend style-guide I provided and work with a fresh mind.